温馨提醒

如果文章内容或图片资源失效,请留言反馈,我们会及时处理,谢谢

本文最后更新于2025年5月24日,已超过 180天没有更新

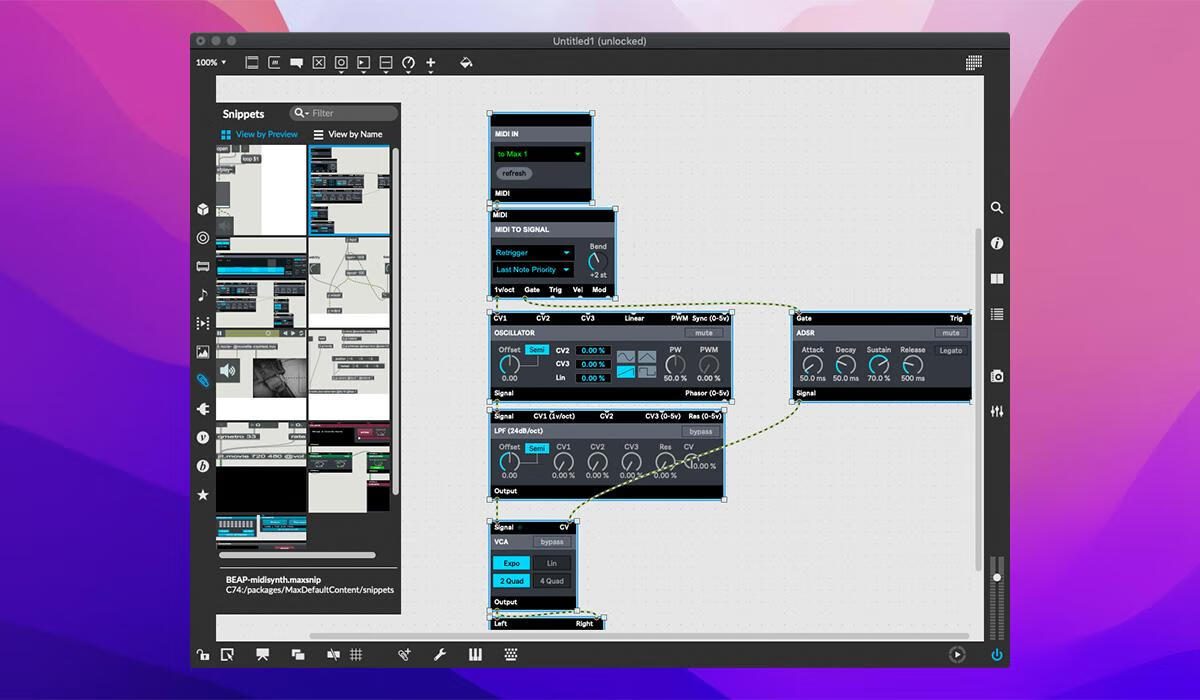

👉 Cycling 74 Max 作为可视化音视频编程领域的标杆工具,凭借模块化节点设计与跨领域创作能力,彻底打破了传统编程的边界。它不仅支持实时音视频信号流处理,更通过硬件传感器直连与AI算法集成,让艺术家无需编写代码即可构建交互装置,教育场景下的学习曲线缩短60%,成为音乐、新媒体艺术与科技融合的创意引擎。

🚀 功能特色亮点

-

🎛️ 模块化信号工坊

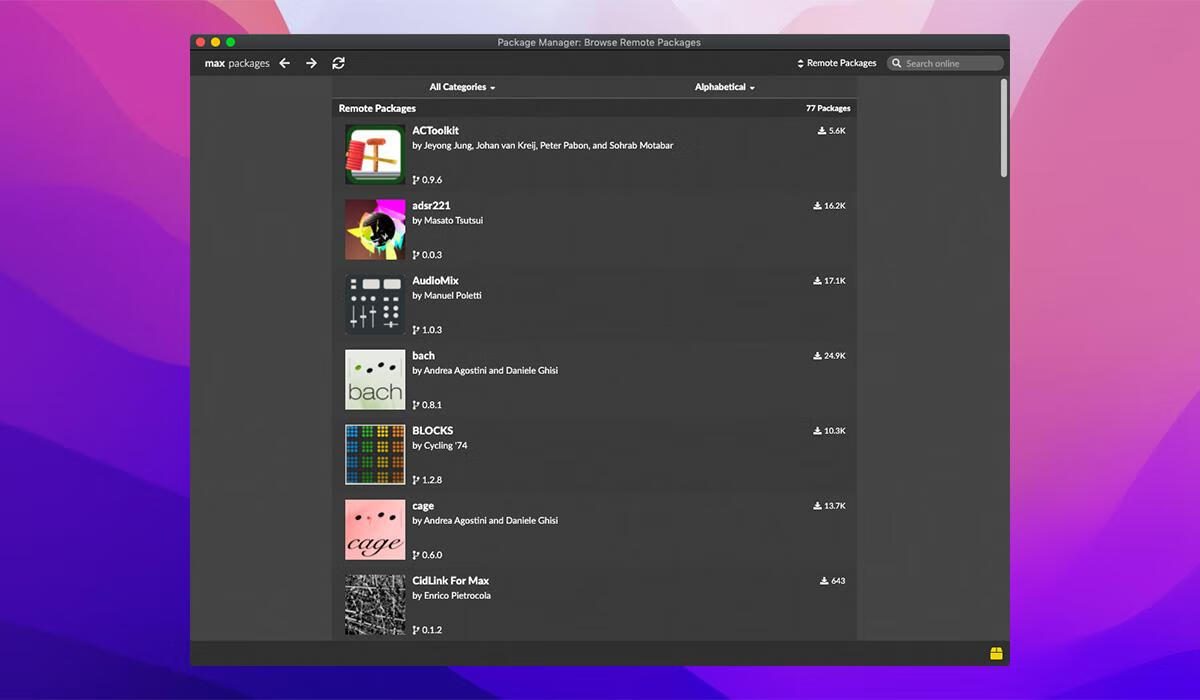

内置2000+预置对象,涵盖物理建模合成、粒子系统生成与神经网络音频分析,支持第三方VST/AU插件扩展生态。 -

🌐 多模态交互系统

通过OSC/MIDI协议直连硬件设备,Arduino传感器数据可实时驱动3D投影与机械装置,创造沉浸式艺术体验。 -

🎨 可视化调试矩阵

信号流以频谱瀑布图呈现,支持断点调试与历史数据回放,异常节点自动标注并推荐优化方案。 -

🤖 AI创作助手

集成Stable Diffusion音频生成模型,输入文本描述即可生成可编辑的音频信号流,支持风格迁移与参数自动化。 -

⚡ 超低延迟引擎

采用Jitter视频处理框架,8K分辨率下延迟低于3ms,多线程调度确保200+并行信号流稳定运行。

👉 场景化功能解析

-

🎹 动态音乐生成器

连接MIDI键盘后,通过概率矩阵控制和弦走向,AI和声引擎实时生成匹配的电子音效与视觉粒子特效。 -

🖼️ 交互式数字艺术

使用Kinect捕捉人体动作,通过骨骼数据映射驱动投影动画与空间音场变化,创作沉浸式展览装置。 -

📚 编程教学实验室

学生拖拽FFT分析模块即可观察声波分解过程,错误节点会触发AR教学提示。

💻 高频使用场景

-

🎵 电子音乐现场

-

通过OSC网络同步多台设备,实时控制灯光矩阵与空间音效

-

使用卷积混响模块模拟著名音乐厅声学特性,配合运动传感器调整混响参数

-

-

🎭 戏剧多媒体设计

-

利用人脸识别API触发角色语音合成,情绪参数实时影响背景音乐张力

-

通过DMX协议将舞台动作数据转化为实时投影映射参数

-

-

🔬 科研数据可视化

-

将地震波数据转换为三维粒子动画,通过触觉反馈装置实现多感官分析

-

使用生物传感器数据流驱动生成艺术,呈现脑电波与音乐节奏的关联性)。

-

💡冷技巧:双击空白工作区并输入"dsp"指令,可激活性能监视器——实时显示每个信号模块的CPU占用率,快速定位资源瓶颈!

激活方法

直接安装

「应用已损坏,打不开.你应该将它移到废纸篓」,详见:“Mac应用”已损坏,打不开解决办法

许可协议:《署名-非商业性使用-相同方式共享 4.0 国际 (CC BY-NC-SA 4.0)》

评论(0)